Die Erstellung einer Wettervorhersage ist ein hochkomplexer Prozess, der mit der lückenlosen Erfassung des aktuellen Zustands der Atmosphäre auf der gesamten Erde beginnt. Überall auf dem Globus messen automatisierte Wetterstationen im Minutentakt Parameter wie die Temperatur, den Luftdruck, die Windgeschwindigkeit und die Luftfeuchtigkeit direkt am Boden. Gleichzeitig steigen mehrmals täglich hunderte von Wetterballons in die Höhe, um wichtige Profile über die verschiedenen Luftschichten bis in die Stratosphäre zu erstellen. Über den Weltmeeren liefern spezialisierte Bojen und Handelsschiffe wertvolle Daten aus Regionen, in denen keine festen Bodenstationen existieren können. Moderne Wettersatelliten ergänzen dieses Bild aus dem Weltraum, indem sie Wolkenbewegungen verfolgen und die Strahlungsbilanz der Erde messen. Sogar Verkehrsflugzeuge sind heute mit Sensoren ausgestattet, die während des Fluges kontinuierlich Informationen über die oberen Luftströmungen an die Bodenstationen funken. All diese Milliarden von Einzeldaten werden in globale Rechenzentren übertragen und dort einer strengen Qualitätskontrolle unterzogen. Nach der Aufbereitung fließen die Informationen in gigantische Supercomputer ein, die ein digitales Abbild der Erdatmosphäre erstellen. Dieses Abbild basiert auf einem dreidimensionalen Gitternetz, das die Erde wie ein feiner Käfig umschließt. Innerhalb dieses Netzes berechnen die Computer die zukünftige Entwicklung der Atmosphäre mithilfe physikalischer Gesetzmäßigkeiten und mathematischer Gleichungen. Da die Atmosphäre ein chaotisches System ist, reagiert sie extrem empfindlich auf kleinste Veränderungen der Ausgangslage. Um diese Unsicherheit zu bewältigen, nutzen Experten sogenannte Ensemble-Prognosen, bei denen das Modell mit leicht variierten Startbedingungen dutzende Male durchgerechnet wird. Zeigen alle Berechnungen ein ähnliches Bild, kann die Vorhersage mit einer hohen Sicherheit an die Öffentlichkeit weitergegeben werden. Wenn die Modelle jedoch völlig unterschiedliche Szenarien entwerfen, deutet dies auf eine instabile und schwer vorhersehbare Wetterlage hin. Trotz der enormen Leistung dieser Rechner ist der Mensch in diesem Prozess nach wie vor unverzichtbar. Erfahrene Meteorologen begutachten die Computerergebnisse und gleichen sie mit ihrem Wissen über regionale Besonderheiten ab. Ein Computer erkennt vielleicht nicht sofort, wie ein enges Tal den Wind verstärkt oder ein Gebirge für lokale Stauregen sorgt. Der Meteorologe korrigiert diese Details und formuliert aus den nackten Zahlen eine für den Laien verständliche Botschaft. Diese aufbereiteten Texte und Karten bilden die Basis für die Warnungen, die wir täglich auf unseren Smartphones oder im Fernsehen sehen. Die Qualität der Vorhersagen hat sich in den letzten Jahrzehnten durch bessere Technik massiv gesteigert. Heute ist eine Prognose für die nächsten drei Tage so präzise wie es eine Vorhersage für den nächsten Tag vor dreißig Jahren war. Dennoch setzt die Physik der Vorhersagbarkeit natürliche Grenzen, die auch mit noch schnelleren Rechnern kaum zu knacken sind. Ab einer Dauer von etwa sieben bis zehn Tagen nehmen die Fehler in den Modellen so stark zu, dass seriöse Punktprognosen unmöglich werden. Die internationale Zusammenarbeit der Wetterdienste sorgt dabei für einen ständigen Austausch von Daten über alle Landesgrenzen hinweg. Nur durch diesen globalen Verbund können wir heute frühzeitig vor gefährlichen Unwettern, Hurrikanen oder Hitzewellen gewarnt werden. Jede Wettervorhersage ist somit ein Meisterwerk aus globaler Logistik, theoretischer Physik und moderner Informationstechnik. Am Ende steht ein Bericht, der uns hilft, unseren Alltag besser zu planen und Gefahren für Leib und Leben rechtzeitig zu erkennen.

Eine moderne Wettervorhersage ist eine beeindruckende Mischung aus High-Tech-Datenerfassung, gigantischer Rechenpower und menschlicher Expertise. Man kann den Prozess grob in vier Schritte unterteilen.

1. Die Bestandsaufnahme (Datensammlung)

Bevor man wissen kann, wie das Wetter wird, muss man wissen, wie es jetzt gerade ist. Über den ganzen Globus verteilt sammeln Millionen von Sensoren ununterbrochen Daten:

- Wetterstationen: Messen Temperatur, Luftdruck und Feuchtigkeit am Boden.

- Wetterballons: Steigen bis in die Stratosphäre auf und liefern Profile der Atmosphäre.

- Satelliten: Beobachten Wolkenbewegungen, Wasserdampf und Strahlung aus dem All.

- Schiffe & Flugzeuge: Liefern Daten von Orten, an denen keine festen Stationen stehen (z. B. mitten auf dem Ozean).

2. Der digitale Zwilling (Numerische Modelle)

Diese gewaltigen Datenmengen werden in Supercomputer eingespeist. Diese Rechner füttern physikalische Simulationsmodelle mit den Werten. Das Ziel: Die Atmosphäre wird in ein dreidimensionales Gitter unterteilt.

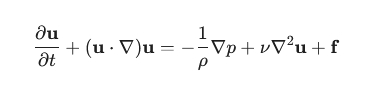

Für jede dieser Gitterzellen berechnet der Computer basierend auf physikalischen Gesetzmäßigkeiten (Thermodynamik, Strömungslehre), wie sich die Luftmassen bewegen. Hier kommen komplexe Formeln zum Einsatz, wie zum Beispiel die Navier-Stokes-Gleichungen:

3. Das „Ensemble“ (Wahrscheinlichkeiten)

Da die Atmosphäre ein chaotisches System ist (der berühmte Schmetterlingseffekt), reicht eine einzige Berechnung nicht aus. Kleine Messfehler am Anfang können zu völlig verschiedenen Ergebnissen führen.

- Deshalb lassen Meteorologen das Modell viele Male gleichzeitig laufen (Ensemble-Prognose), jedes Mal mit leicht veränderten Startwerten.

- Kommen 40 von 50 Berechnungen zum selben Ergebnis, ist die Vorhersage „sicher“. Gehen die Linien weit auseinander, ist die Lage unsicher.

4. Der menschliche Feinschliff

Trotz aller KI und Supercomputer sitzen am Ende immer noch Menschen (Meteorologen) in der Schaltzentrale. Sie kennen die regionalen Besonderheiten – zum Beispiel, wie ein bestimmtes Gebirge den Wind ablenkt, was ein globales Modell vielleicht zu grob darstellt. Sie interpretieren die Daten und erstellen daraus die Karten und Texte, die wir in der App oder im Fernsehen sehen.

Wissenswert: Warum wird es nach 7 Tagen ungenau? Die Genauigkeit einer 24-Stunden-Prognose liegt heute bei über 90 %. Da sich Fehler in der Berechnung jedoch exponentiell aufschaukeln, sinkt die Trefferquote nach etwa 7 bis 10 Tagen rapide ab. Eine exakte Prognose für einen spezifischen Ort in drei Wochen ist physikalisch schlicht unmöglich.

Die Struktur einer Wettervorhersage folgt einer logischen Hierarchie, die vom Großen (dem Kontinent) zum Kleinen (deiner Haustür) führt. Hier sind die wesentlichen Bausteine.

- Die Großwetterlage: Den Rahmen bildet die Analyse von Hoch- und Tiefdruckzentren über ganz Europa oder dem Atlantik. Hier wird geklärt, ob wir es mit einer stabilen Hochdruckbrücke oder einer dynamischen Westwindzone zu tun haben.

- Die Luftmassencharakteristik: Es wird bestimmt, welche Art von Luft herangeführt wird. Kommt sie aus der polaren Region (kalt und klar), vom Atlantik (mild und feucht) oder aus der Sahara (heiß und staubig)?

- Die Frontensysteme: Hier geht es um die Dynamik. Wo liegen Warm- und Kaltfronten? Diese Grenzen entscheiden darüber, wann genau Regenbanden durchziehen und wie sich die Temperatur sprunghaft ändert.

- Die Parametrisierung: Dies ist der Teil, den wir meistens in der App sehen. Hier werden die abstrakten Modelle in konkrete Zahlen für Temperatur (Minimum/Maximum), Niederschlagsmenge, Windgeschwindigkeit und Luftfeuchtigkeit übersetzt.

- Die zeitliche Gliederung:

- Nowcasting: Die exakte Vorhersage für die nächsten 2 bis 6 Stunden (sehr präzise).

- Kurzfrist: Der Zeitraum für heute und morgen.

- Mittelfrist: Der Trend für die nächsten 3 bis 7 Tage.

- Die Regionalisierung: Hier werden topografische Besonderheiten eingerechnet. Dazu gehören Staueffekte an Gebirgen, die Nebelanfälligkeit in Flusstälern oder der kühlende Effekt des Meeres an der Küste.

- Das Warnmanagement: Ein struktureller Sonderbereich, der nur aktiviert wird, wenn Schwellenwerte (z. B. Wind ab 75 km/h oder extreme Hitze) überschritten werden.

- Die Unsicherheitsbewertung: In modernen Berichten wird oft mit Wahrscheinlichkeiten gearbeitet (z. B. „Regenrisiko 60 %“), was die Verlässlichkeit der aktuellen Modellberechnungen widerspiegelt.

Große Wetterorganisationen der Welt

Hinter jeder Wetter-App und jedem Fernsehbericht stehen gigantische Organisationen, die hunderte Millionen Euro in Supercomputer, Satelliten und Forschung investieren. Man unterscheidet dabei zwischen koordinierenden Weltorganisationen, staatlichen Wetterdiensten und privaten Giganten.

1. Die Weltorganisation (WMO)

Die World Meteorological Organization (WMO) mit Sitz in Genf ist eine Sonderorganisation der Vereinten Nationen. Sie macht selbst keine Wettervorhersagen, ist aber das Herzstück des Systems:

- Sie sorgt dafür, dass alle Länder ihre Wetterdaten nach denselben Standards messen und kostenlos teilen.

- Ohne die WMO gäbe es keinen weltweiten Datenaustausch – und damit keine Vorhersage über Landesgrenzen hinweg.

2. Die wissenschaftlichen „Schwergewichte“ (Modell-Betreiber)

Diese Institutionen betreiben die komplexesten Wettermodelle der Welt, auf die fast alle anderen Dienste zugreifen:

- ECMWF (European Centre for Medium-Range Weather Forecasts): Sitz in Reading (UK) und Bonn. Es gilt als der weltweite Goldstandard. Sein Modell (IFS) liefert die präzisesten Vorhersagen für den Zeitraum von 3 bis 10 Tagen.

- NOAA / NWS (National Oceanic and Atmospheric Administration): Die US-Behörde betreibt das GFS-Modell. Da ihre Daten komplett kostenlos und frei verfügbar sind, basieren die meisten Gratis-Wetter-Apps weltweit auf den Berechnungen der NOAA.

- DWD (Deutscher Wetterdienst): Einer der weltweit führenden Dienste. Sein ICON-Modell ist technisch hochmodern und wird von vielen anderen europäischen Ländern mitgenutzt, da es eine besonders hohe Auflösung bietet.

3. Wichtige nationale Dienste

Jedes Land hat seinen eigenen Dienst, der die Verantwortung für Katastrophenschutz und Warnungen trägt:

- Météo-France: Führend in der Forschung für den Mittelmeerraum und Westeuropa.

- Met Office (Großbritannien): Bekannt für seine Expertise bei Meeresströmungen und dem Jetstream.

- JMA (Japan Meteorological Agency): Weltweit führend bei der Vorhersage von Taifunen und marinen Wetterphänomenen.

4. Die privaten Giganten

Diese Unternehmen besitzen oft keine eigenen Messstationen, haben aber die besten Schnittstellen und Algorithmen zur Datenaufbereitung:

| Unternehmen | Besonderheit |

|---|---|

| The Weather Company (IBM) | Liefert die Daten für Apple-Geräte und ist der größte kommerzielle Anbieter. |

| AccuWeather | US-Riese, der für seine extrem detaillierten (wenn auch manchmal umstrittenen) Minutenvorhersagen bekannt ist. |

| Meteoblue | Ein Spin-off der Universität Basel, das für seine präzisen grafischen Darstellungen und Spezialdaten weltweit geschätzt wird. |

Interessanter Fakt: Während die staatlichen Dienste wie der DWD oder die NOAA die „Rohdaten“ und die Physik liefern, spezialisieren sich die Privaten darauf, diese Daten für den Endnutzer so schick und einfach wie möglich aufzubereiten.